Unsere Daten werden im Internet inzwischen überall gesammelt und auch zum Training von Large Language Models wie ChatGPT eingesetzt. Doch wie wird die Künstliche Intelligenz (KI) trainiert, wie wird sichergestellt, dass keine Verzerrungen, sogenannte Bias in den Modellen entstehen und wie wird dabei der Datenschutz eingehalten? Antworten auf diese Fragen gibt Reinhard Heckel, Professor für Maschinelles Lernen an der Technischen Universität München (TUM). Er forscht zu Large Language Models und bildgebenden Verfahren in der Medizin.

Welche Rolle spielen Daten beim Trainieren von KI-Systemen?

KI-Systeme nutzen Daten als Trainingsbeispiele. Large Language Models wie ChatGPT können nur Fragen zu Themen beantworten, auf die sie auch trainiert worden sind.

Die meisten Informationen, die allgemeine Sprachmodelle zum Training verwenden, sind Daten, die im Internet frei zugänglich sind. Je mehr Trainingsdaten zu einer Frage vorliegen, desto besser sind auch die Ergebnisse. Liegen zum Beispiel für eine KI, die bei Mathematikaufgaben helfen soll, viele gute Texte vor, die Zusammenhänge in der Mathematik beschreiben, sind die Trainingsdaten entsprechend gut. Gleichzeitig wird bei der Auswahl der Daten im Moment sehr stark gefiltert. Aus der großen Masse an Daten werden nur die guten Daten gesammelt und für das Training verwendet.

Wie wird bei der Auswahl der Daten verhindert, dass die KI zum Beispiel rassistische oder sexistische Stereotypen, sogenannte Bias produziert?

Es ist sehr schwer eine Methode zu entwickeln, die nicht auf klassische Stereotype zurückgreift und unvoreingenommen und fair agiert. Möchte man zum Beispiel verhindern, dass es eine Verzerrung der Ergebnisse hinsichtlich der Hautfarbe gibt, ist das relativ einfach. Kommt aber neben der Hautfarbe auch noch das Geschlecht hinzu, können Situationen entstehen, bei denen es nicht mehr möglich ist, dass das Modell völlig unvoreingenommen in Bezug auf die Hautfarbe und das Geschlecht gleichzeitig agiert.

Die meisten Sprachmodelle versuchen deswegen zum Beispiel bei politischen Fragen eine ausgewogene Antwort zu geben und mehrere Perspektiven zu beleuchten. Beim Training auf Grundlage von Medieninhalten werden Medien bevorzugt, die den journalistischen Qualitätskriterien entsprechen. Außerdem wird beim Filtern von Daten darauf geachtet, dass bestimmte Worte, die beispielsweise rassistisch oder sexistisch sind, nicht vorkommen.

In einigen Sprachen gibt es sehr viele Inhalte im Internet, bei anderen hingegen deutlich weniger. Wie wirkt sich das auf die Qualität der Ergebnisse aus?

Der größte Teil im Internet ist auf Englisch. Dadurch funktionieren Large Language Models in Englisch am besten. Aber auch für die deutsche Sprache gibt es sehr viele Inhalte. Bei Sprachen hingegen, die nicht so bekannt sind und für die nicht so viele Texte existieren, gibt es weniger Trainingsdaten und die Modelle funktionieren dadurch schlechter.

Wie gut Sprachmodelle in bestimmten Sprachen eingesetzt werden können, lässt sich aber ganz einfach beobachten, da sie sogenannten Skalierungsgesetzen folgen. Dabei wird getestet, ob ein Sprachmodell in der Lage ist, das nächste Wort vorherzusagen. Je mehr Trainingsdaten vorliegen, desto besser wird auch das Modell. Aber es wird dabei nicht nur immer besser, sondern auch vorhersagbar besser. Dies lässt sich gut durch eine mathematische Gleichung abbilden.

Wie genau muss eine KI in der Praxis sein?

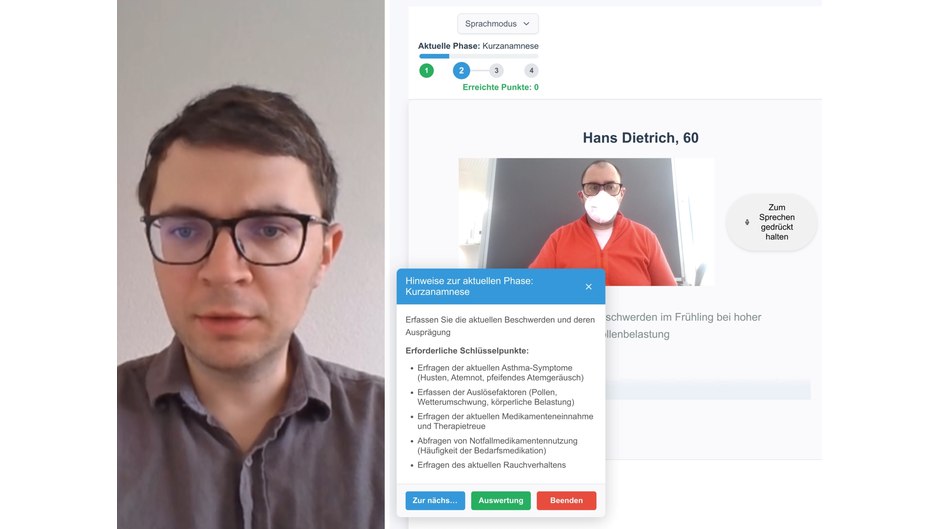

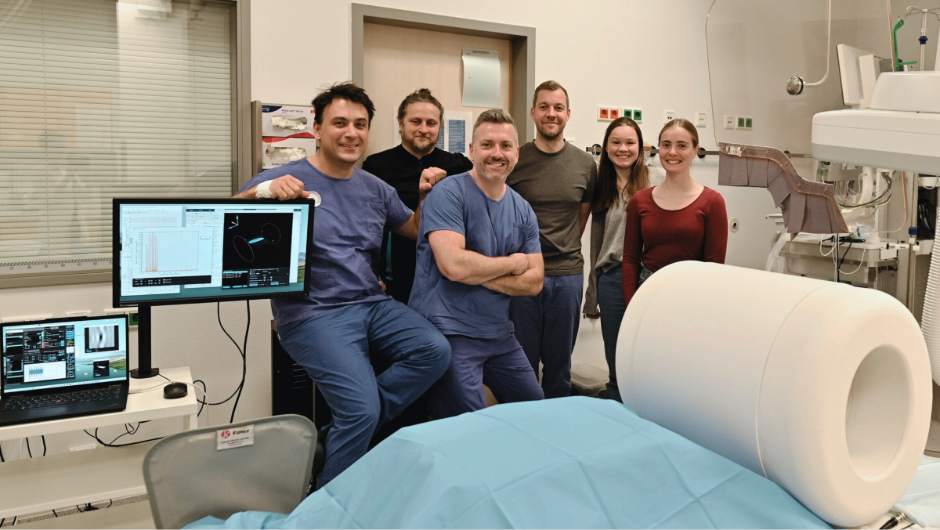

Das hängt sehr vom jeweiligen Anwendungsbereich ab. Bei Fotos beispielsweise, die mithilfe von KI nachbearbeitet werden, kommt es nicht darauf an, ob am Ende jedes Haar an der richtigen Stelle ist. Es reicht oft, wenn ein Bild am Ende gut aussieht. Auch bei Large Language Models ist es wichtig, dass die Fragen gut beantwortet werden, ob Details fehlen oder fehlerhaft sind, ist nicht immer ausschlaggebend. Neben Sprachmodellen forsche ich aber auch im Bereich der medizinischen Bildverarbeitung. Hier ist es sehr wichtig, dass wirklich jedes Detail von einem erzeugten Bild stimmt. Nutze ich hier KI für Diagnosen, muss diese absolut richtig sein.

Im Zusammenhang mit KI wird häufig auch der fehlende Datenschutz diskutiert. Wie wird sichergestellt, dass die persönlichen Daten insbesondere im medizinischen Kontext geschützt werden?

Bei den meisten medizinischen Anwendungen werden Daten von Patientinnen und Patienten verwendet, die anonymisiert sind. Die eigentliche Gefahr besteht nun darin, dass es Situationen gibt, in denen man aus den Daten doch Rückschlüsse ziehen kann. Zum Beispiel lässt sich anhand der MRT- oder CT-Scans oft das Alter oder das Geschlecht zurückverfolgen. Also einige eigentlich anonymisierte Informationen stecken in den Daten. Hier ist es wichtig, die Patientinnen und Patienten ausreichend aufzuklären.

Welche weiteren Schwierigkeiten gibt es beim Training von KI im medizinischen Kontext?

Eine große Schwierigkeit besteht darin, Daten zu sammeln, die sehr viele unterschiedliche Situationen und Szenarien abbilden. KI funktioniert am besten, wenn die Daten, auf die sie angewendet wird, den Trainingsdaten ähnlich sind. Jedoch unterscheiden sich die Daten von Krankhaus zu Krankenhaus zum Beispiel im Hinblick auf die Patientenzusammensetzung oder die Apparaturen, die Daten generieren. Um das Problem zu lösen, gibt es zwei Möglichkeiten: Entweder es gelingt uns die Algorithmen zu verbessern oder wir müssen unsere Daten so optimieren, dass sie besser auch auf andere Situationen angewendet werden können.

Zur Person:

Prof. Reinhard Heckel forscht im Bereich des Maschinellen Lernens. Er arbeitet an der Entwicklung von Algorithmen und theoretischen Grundlagen für deep learning. Ein Fokus liegt dabei auf der medizinischen Bildverarbeitung. Darüber hinaus entwickelt er DNA-Datenspeicherung und beschäftigt sich mit der Nutzung von DNA als digitale Informationstechnologie.

Außerdem ist er Mitglied des Munich Data Science Institutes und des Munich Center for Machine Learning.

https://www.tum.de/aktuelles/alle-meld ... ilungen/details/daten-sin...

Foto: Reinhard Heckel, Professor für Maschinelles Lernen © Astrid Eckert, Muenchen

Quelle: Technische Universität München